音割れ・ノイズ・無音——3大トラブルを完全制圧する2025年版実践技術

対象読者: 映像制作・IP伝送ワークフローに関わるすべての現場ビギナーエンジニア

「音が割れている」——その1本で、あなたの信頼は0になる

IP伝送によるリモートプロダクションが当たり前になった今、映像の旅はカメラのセンサーからネットワークを越えて視聴者のデバイスまで届く。しかし、どれほど精巧なシステムを組んでも、変わらない鉄則がある。

音が破綻すれば、すべてが崩れる。

これは精神論ではない。認知心理学の枠組みから説明できる事実だ。人間の脳は、視覚情報と聴覚情報を異なる経路で処理している。視覚的な情報は大脳新皮質の視覚野で分析され、論理的な状況把握に使われる。一方、音の情報は聴覚野から扁桃体(へんとうたい)——感情や不快感を司る部位——へと直結する経路を持つ(LeDoux, J. E., 1996, “The Emotional Brain”)。

これが意味するのは、音が割れていると脳は「情報が理解できない」ではなく「生理的に不快だ」という反応を起こす、ということだ。視聴者は理由を考えるより先に、画面を閉じる。

さらに、認知負荷理論(Sweller, J., 1988, “Cognitive load during problem solving”, Cognitive Science)によれば、ノイズの混じった音声を聴き取ろうとする行為は、脳に強制的な処理コストを課す。人間の脳には一度に処理できる情報量の上限があり、音声の聴き取りにリソースを消費すると、コンテンツの内容を理解するための帯域が削られていく。

YouTube Creator Academyは「最初の数秒が視聴継続の分岐点になる」と明記している。映像品質の粗さは「古い機材かな」と解釈されることがあるが、音の破綻は「作り手が視聴者のことを考えていない」という感情的判断に直結する。これが冒頭に述べた「信頼の喪失」の正体だ。

現場で起きている音響トラブルは、3つに分類できる

長年の現場経験と機材テストを通じて言えることがある。映像制作における音響トラブルは、その原因が何であれ、以下の3タイプに集約される。

第1のトラブル:音割れ(クリッピング) 録音時に信号が許容範囲を超え、波形が切り取られる現象。一度発生したら、編集での完全修復は理論上不可能だ。

第2のトラブル:ノイズの混入 環境・機材・話者の発音に起因する不要な音が混入する現象。発生源は7パターンに体系化できる。

第3のトラブル:無音 「音が全く入っていない」という最も壊滅的なトラブル。原因は物理接続、OS設定、操作ミスの3系統に分類できる。

これら3つには、それぞれ異なる発生メカニズムがあり、対処法も根本から異なる。「とにかく大きな声で録れば大丈夫」でも「高価なマイクを買えば解決する」でもない。正しい理解と正しい手順だけが、問題を根絶する。

2025年、初心者が「プロの音」を手に入れるための条件が揃った

32-bit Float録音技術、AIを活用したリアルタイムノイズ抑制、そしてOBS Studioの高度なフィルタチェーン——これらの技術革新により、機材コストを大幅に抑えながらプロクオリティの音声を収録できる環境が整った。

しかし、ツールをただ使うだけでは意味がない。「なぜ音が割れるのか」「なぜこのマイクを選ぶのか」という理論的裏付けがなければ、トラブルが起きたときに手が止まる。IP伝送ワークフローにおけるサンプリングレートの統一問題、AES67規格との整合性、マルチソース収録でのゲインステージング——これらは現場で即座に判断しなければならない問題だ。

この記事の有料部分では、以下を完全解説する。

- 3大音響トラブルの原因を発生メカニズムから完全分解し、各対処法をステップバイステップで解説

- マイク選定の工学的根拠(コンデンサー vs ダイナミック、指向性の選択)

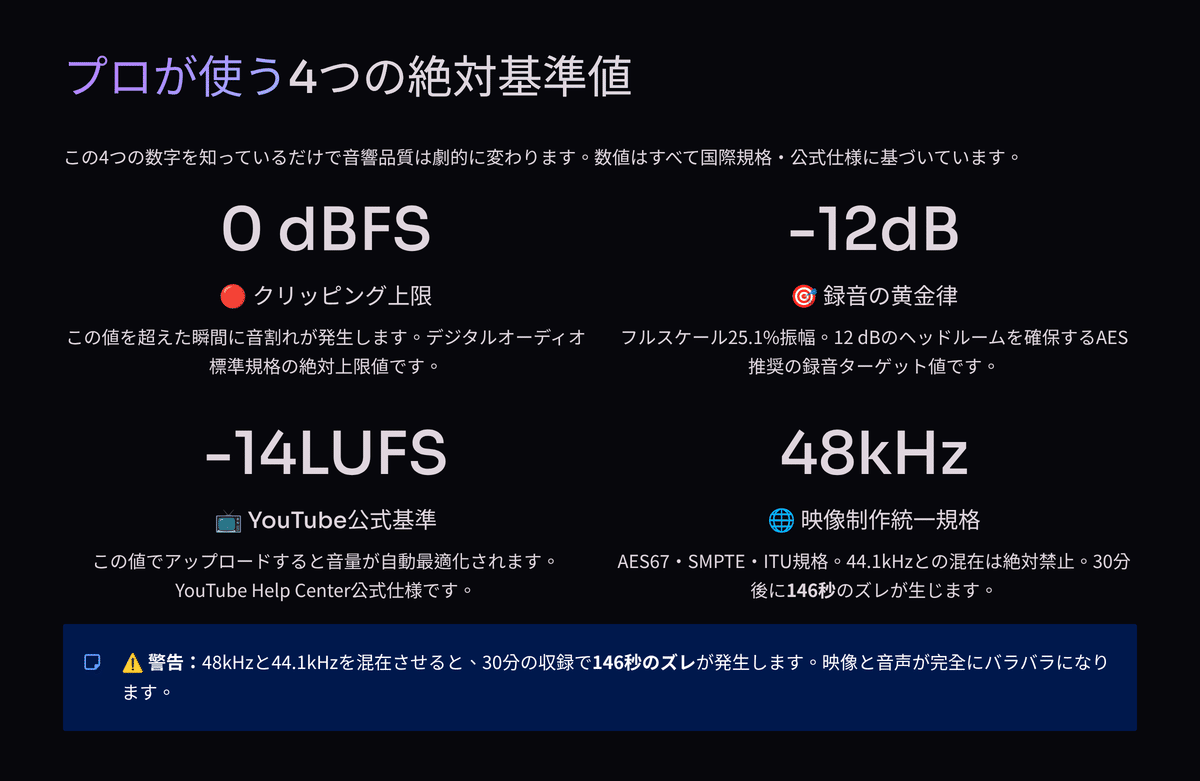

- デジタル録音の数学:なぜ「−12 dBFS」が黄金律なのか、計算式とその根拠

- 32-bit Float革命:理論値1,500 dB以上のダイナミックレンジが実際に意味すること

- OBS Studioの5段フィルタチェーン:順序と設定値の完全ガイド

- Adobe Premiere Proによる収録後音声修復の実践技術

- サンプリングレート不一致が引き起こす音ズレの計算根拠と完全防止策

- 現場プロが実践する「音ハン(音のロケハン)」の具体的手順

音は映像に付随するものではなく、物語の骨格だ。その骨格を正しく設計するための完全ガイドを、ここに公開する。

コメント