唇が動いて、声が遅れる——その45ミリ秒が、視聴者をコンテンツから引き離す

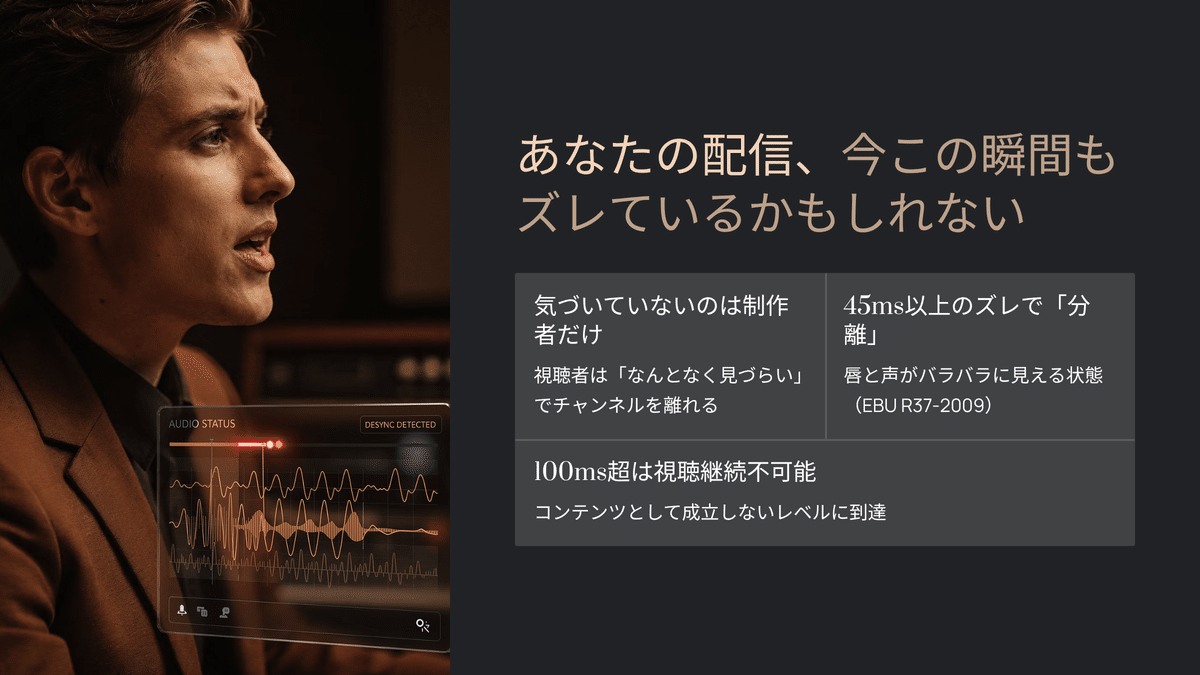

「映像はきれいなのに、なんか見づらい」

視聴者がそう感じてチャンネルを離れるとき、その原因のひとつは、画質でもビットレートでもない。唇の動きと声のタイミングのズレ——いわゆる「リップシンクのズレ」だ。

欧州放送連合(EBU)が策定したAV同期基準(EBU R37-2009)によれば、音声が映像に対して45ミリ秒以上遅れた場合、視聴者は「唇の動きと声が明確に分離している」と知覚する。100ミリ秒を超えると、コンテンツとしての品質を維持できないと判断されるレベルだ。

そして現場で気づきにくいのは、IP伝送システムでは、この「ズレ」が配信開始後に動的に変化するという事実だ。

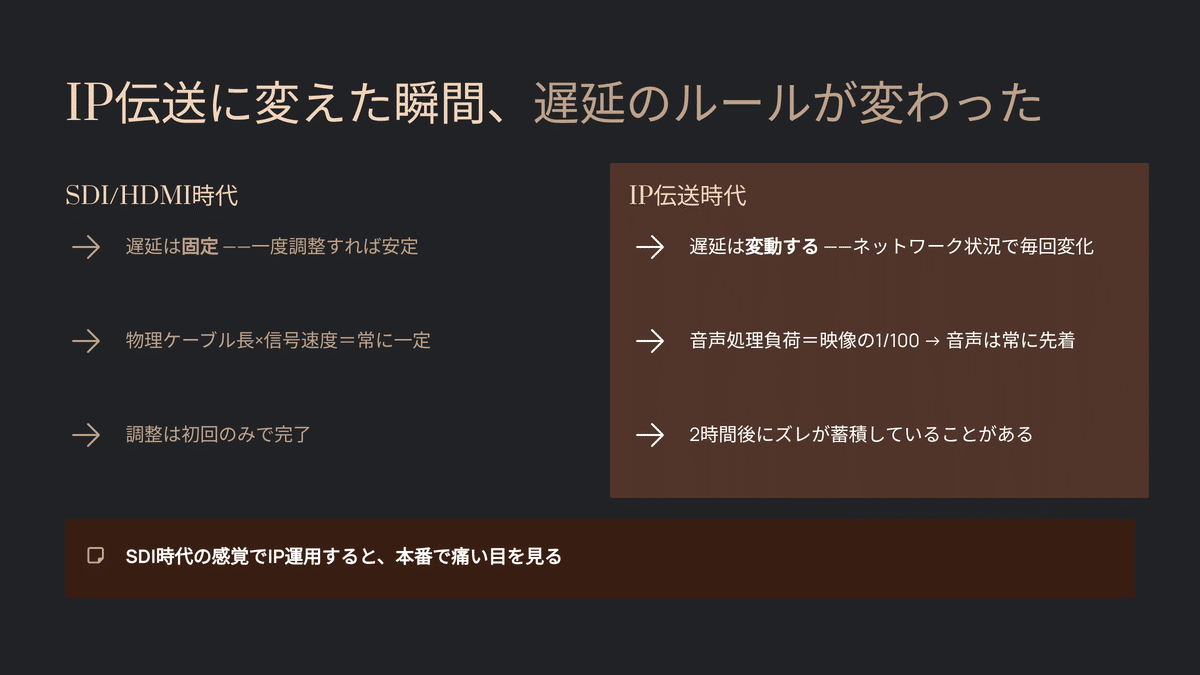

同軸ケーブルやSDIで構築した従来のシステムでは、遅延は「固定的」だった。一度調整すれば、数時間後も同じ状態が保たれた。しかしIPネットワーク経由の伝送では、ネットワークの混雑、CPUの負荷状況、パケットの到着順序の乱れ(ジッター)によって、遅延は配信中も変動し続ける。本番開始時には完璧だったリップシンクが、2時間後にはズレている——それがIP伝送の現実だ。

なぜ、映像は必ず音声より遅れるのか

「光より音の方が速いのか?」と思うかもしれない。自然界では逆だ。光は秒速299,792,458メートルで進み、音は秒速343メートル(気温20℃)でしか伝わらない。10メートル先の出来事は、視覚には0.000033ミリ秒で届き、聴覚には29.2ミリ秒かけて届く。自然界では視覚が先行するのが普通だ。

デジタルシステムでは、この関係が逆転する。

音声データの処理は、波形を数値に変換するだけで完結する。映像データは違う。1フレーム(1920×1080ピクセルで約207万点のデータ)を処理するために、カメラ内部での補正処理、スイッチャーでのフレーム同期、エンコーダーでの圧縮計算が積み重なる。音声処理と映像処理の計算負荷の差は、同じデジタル信号処理でも桁が違う。

この結果として「軽い音声が先に処理を終えて出力され、重い映像が後から追いつく」という状態が、あらゆるデジタル映像システムで発生している。

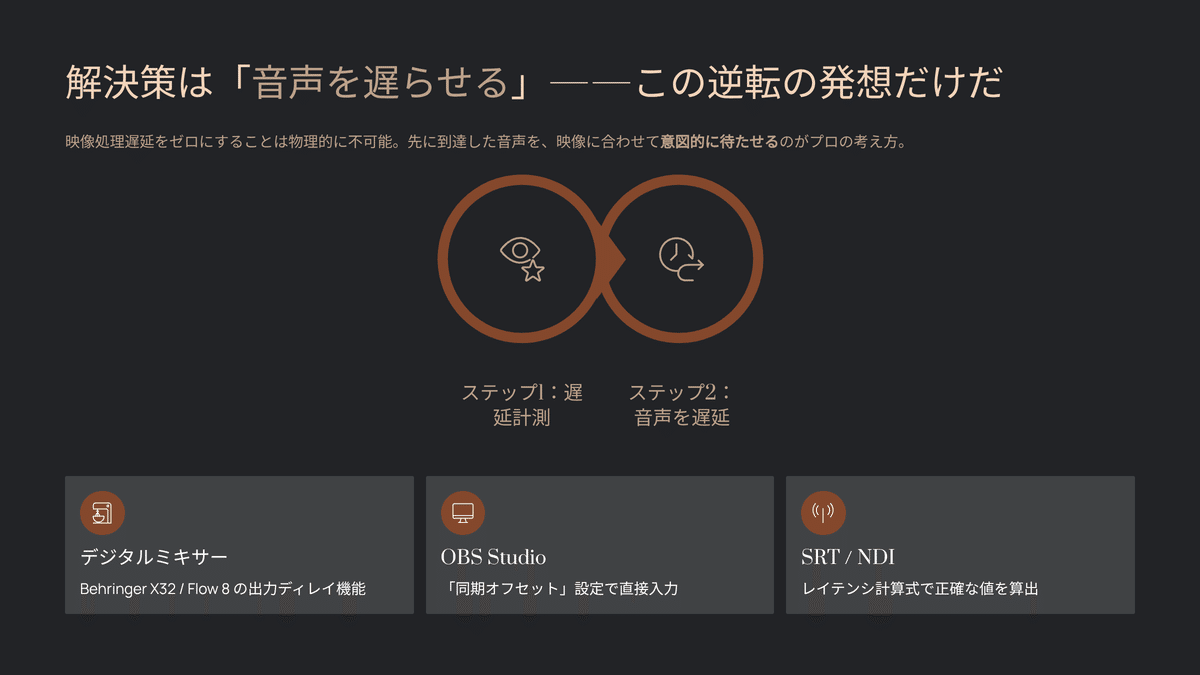

解決の核心は、たった1つのシンプルな原則

「映像処理の遅延をゼロにする」のは物理的に不可能だ。カメラのセンサーが光を捉えてから出力端子に映像が到達するまで、どれほど高性能な機材でも数フレーム分の時間は必要だ。

この記事が伝える解決策の核心はこうだ——先に到達した音声を、映像の到達時間に合わせて「意図的に遅らせる」。

その「何ミリ秒遅らせるか」を正確に計算し、デジタルミキサーや配信ソフトウェアで補正する手順が、本記事の有料エリアで完全に公開されている。

この記事で得られる知識と技術

有料エリアでは、以下のすべてを網羅している。

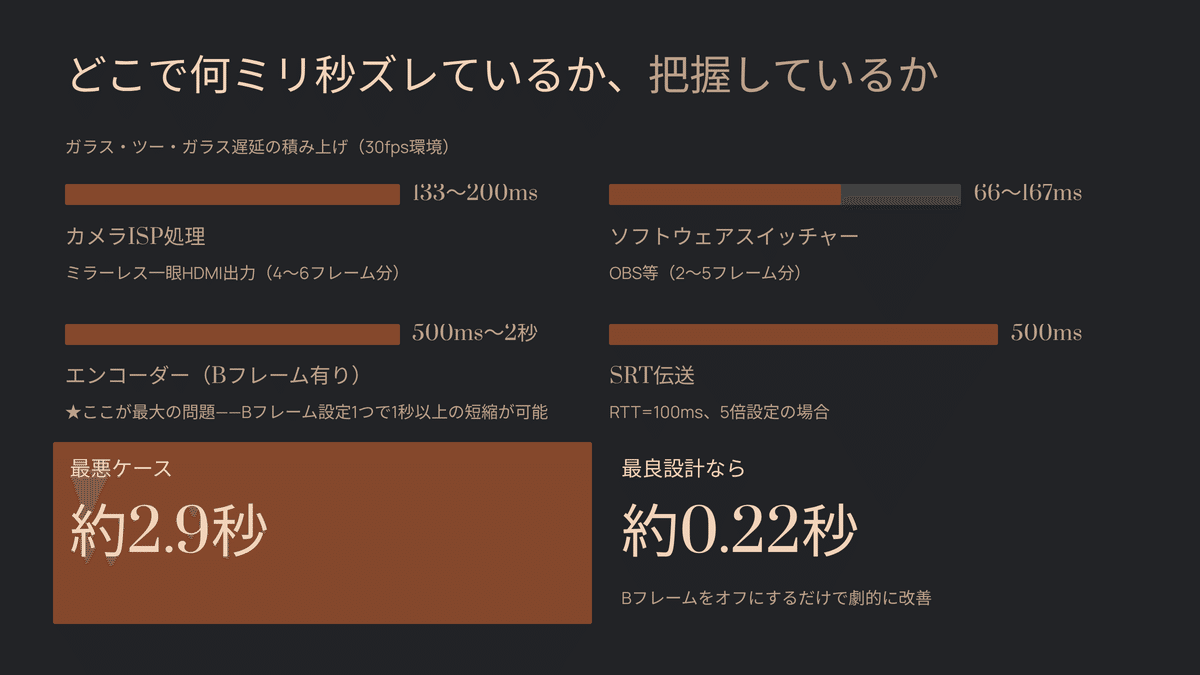

信号鎖の各段階(カメラ内部・スイッチャー・エンコーダー・IP伝送)でそれぞれ何ミリ秒の遅延が発生するか、その計算根拠つきの早見表。NDI(Network Device Interface)とSRT(Secure Reliable Transport)という2大IP伝送プロトコルが持つ同期メカニズムの違いと、それぞれに最適な設定値の算出方法。Behringer X32とFlow 8でのディレイ補正手順(ステップバイステップ)、OBS Studioの同期オフセット設定の具体的な数値入力手順。「手拍子1回」で全システムの遅延量を計測するクラッパーテストの完全手順と、フレーム差からミリ秒への換算計算。そして、長時間配信で徐々にズレが蓄積する「ドリフト」現象の原因と、システム設計レベルでの予防策。

SDIからIPへの移行を検討しているエンジニアから、すでにIPシステムで運用しているが「なぜかズレる」を解決できていないオペレーターまで、このガイドは現場でそのまま使える実践書だ。

コメント