——映像品質を決める信号処理の設計思想と、YouTube最適化の実践戦略——

対象読者: 大学の映画・映像学科や放送技術専門学校の「技術補習」を前提に、単なる再説明ではなく「現場で使える再構築」と「抜けている実務スキルの補完」が軸になります。撮影・制作業務に携わり、IP伝送・配信技術に関心を持つすべての映像プロフェッショナル

撮影現場で積み上げた品質は、なぜ配信の瞬間に失われるのか

あなたの映像は、画面の外で「死んで」いる

4Kカメラで丁寧に撮影し、時間をかけてカラーグレーディングし、「完璧だ」と確信して書き出した映像を、YouTubeにアップロードした瞬間——色がくすみ、シャープさが消え、暗部にブロック状のノイズが走る。

この経験に心当たりはあるだろうか。

問題は撮影技術ではない。問題は「映像が数字としてどのように処理・変換されているか」を理解していないことにある。

どれほど精密にレンズを選び、露出を決めても、その後の工程で何が起きているかを知らなければ、品質は「記録・編集・配信」の3工程のうち少なくとも1か所で必ず失われる。そしてその「どこか」は、実は3か所に特定できる。

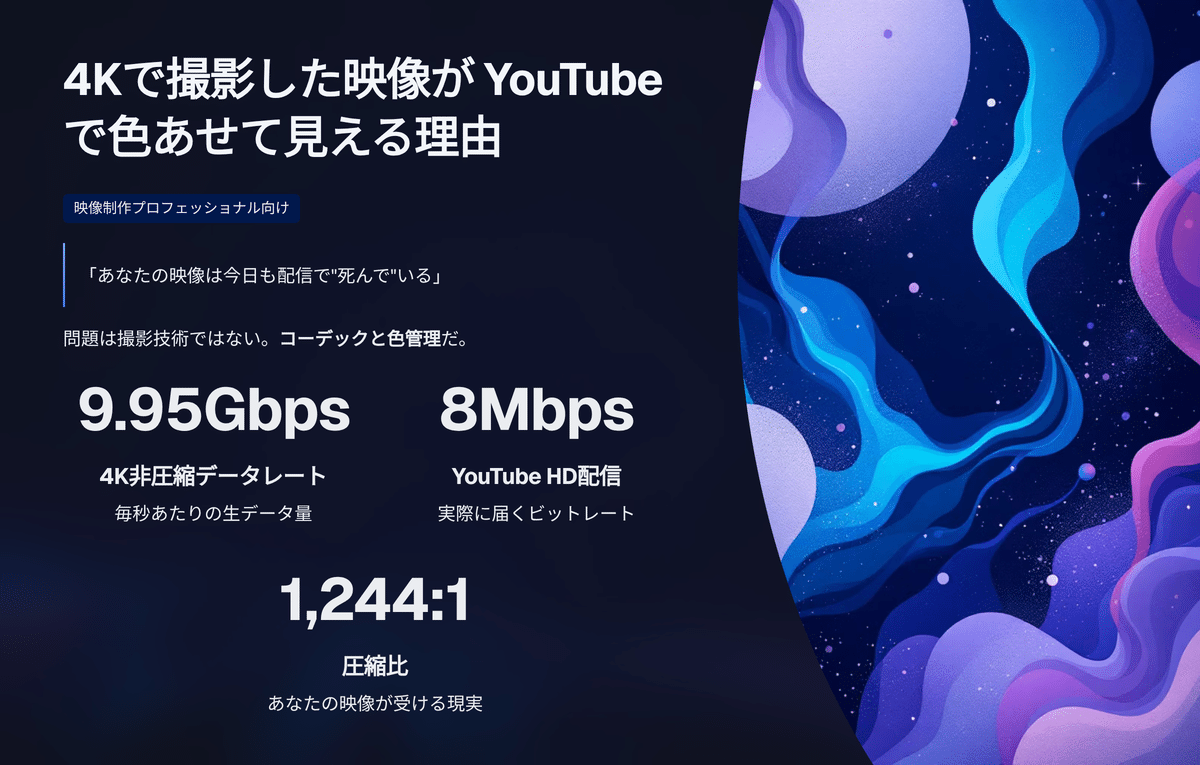

データの現実:毎秒9.95ギガビットという壁

4K映像(3,840×2,160ピクセル)を60コマ/秒、10bit精度、4:2:2カラーサンプリングで記録した場合の非圧縮データ量を計算してみよう。

3,840 × 2,160 × 60 × 10 × 2(4:2:2サンプリング係数)= 9,953,280,000 bit/秒 ≒ 毎秒9.95ギガビット(約1.24ギガバイト/秒)

計算根拠:ITU-R BT.2077に基づくYCbCrサンプリング構造。4:2:2は輝度(Y)が4サンプルに対し色差(Cb/Cr)が各2サンプルのため、総サンプル数は輝度のみの場合の2倍。

YouTubeのHD配信推奨ビットレートは8Mbps。つまり非圧縮に対して1,244分の1以下に圧縮して届けることになる。

この圧縮の過程で何が起きているのか。どこで品質が落ち、どこで品質を守れるのか。これを理解せずに映像制作をするのは、精密機器を設計図なしで組み立てるようなものだ。

プロが見落とす「品質崩壊の3つの断絶点」

現場で映像システムの設計・運用に携わった経験から言えば、映像品質が失われる「断絶点」は以下の3か所に集約される。

第一の断絶:記録時のコーデック選択。 カメラが吐き出すデータをどの形式で保存するか。ここでの選択が、後工程のすべてを決定づける。特に「編集用」と「配信用」を混同したコーデック選択は、タイムライン上の「カクつき」や「編集ソフトのフリーズ」という形で現れる。

第二の断絶:色空間の管理。 撮影時の色情報が、編集→書き出し→プラットフォーム配信の過程でどのように変換されるかを正確に把握していなければ、色は必ずどこかでズレる。特にMacで編集しているプロに顕著な「書き出した映像がなぜか薄く、コントラストが落ちて見える」現象は、この断絶が原因だ。

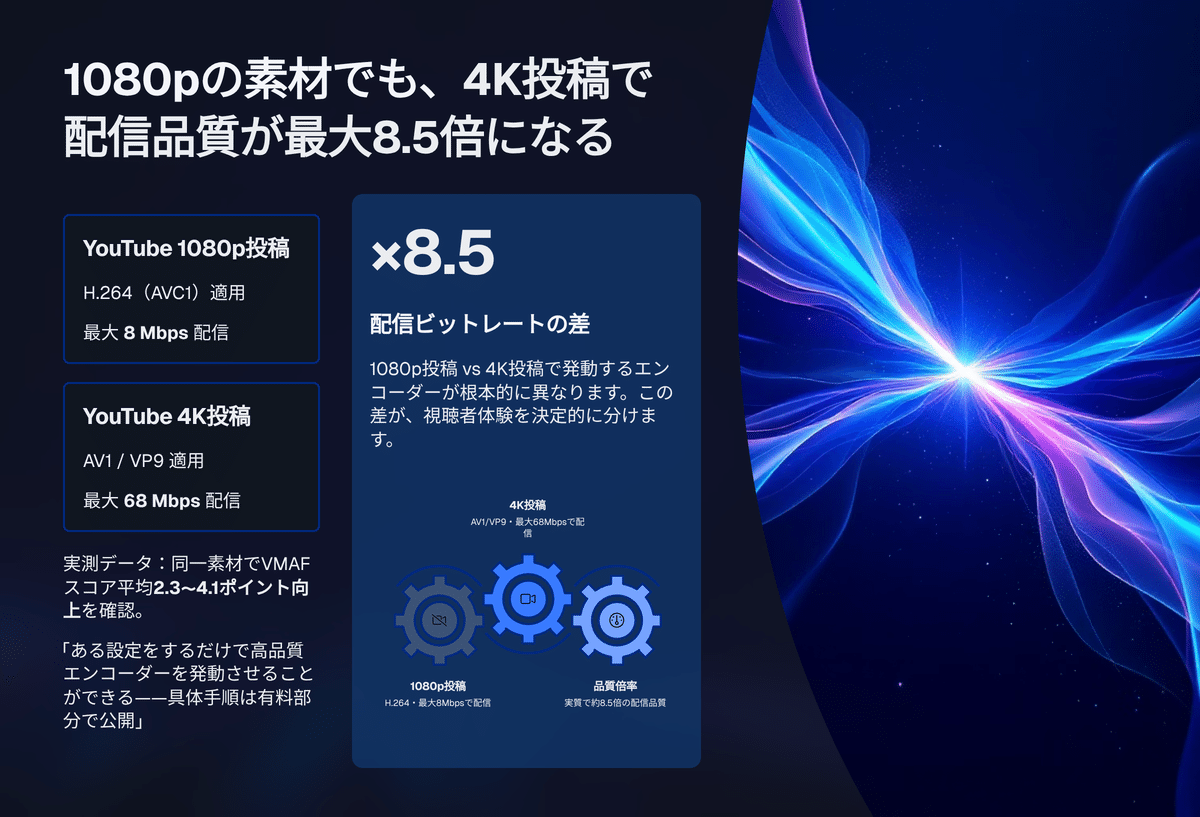

第三の断絶:配信プラットフォームの再圧縮。 YouTubeはアップロードされた全動画を、独自のエンコーダーで必ず再圧縮する。この再圧縮の挙動を知らずにいると、自分が意図した画質は届かない。しかし、この仕組みを逆手に取れば、同じ素材でも視聴者の体験を大きく変えることができる。

この記事で得られること

本記事の有料部分では、以下を体系的に解説する。

圧縮の原理から始まる理論的基盤 ——なぜ圧縮が必要で、どの情報が削られているのかを、数学的な裏付けとともに示す。

フレーム構造とコーデック選択の実践基準 ——All-IとLong-GOPの設計哲学の違いを理解し、「いつどちらを使うか」を明確な判断基準で選べるようにする。

色空間管理の具体的手順 ——Rec.709からRec.2020へ、そしてMac環境でのNCLCタグ問題の解決手順をステップバイステップで示す。

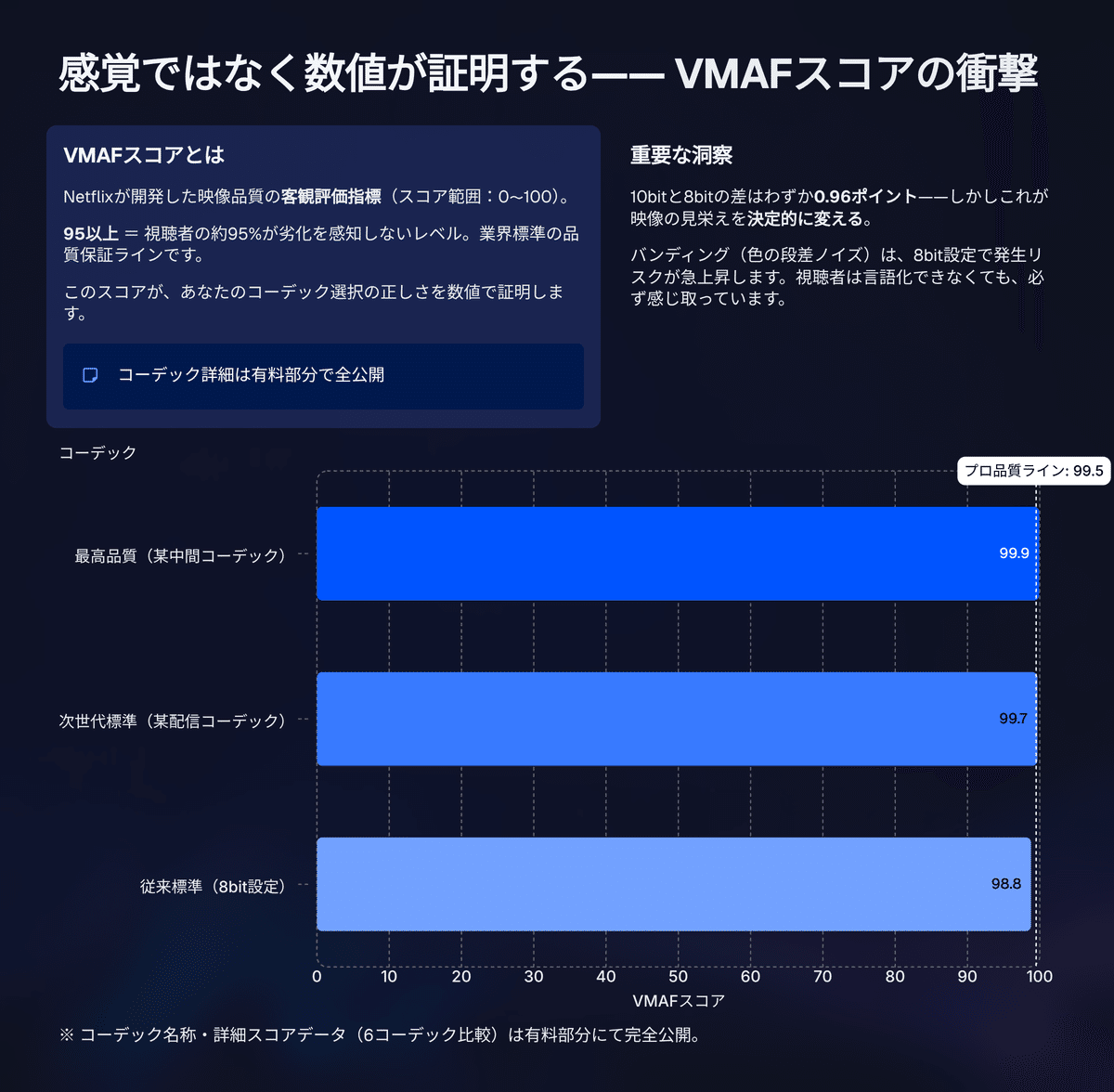

VMAFスコアに基づくコーデック比較データ ——主観ではなく、客観的な品質指標をもとに、どのコーデック・設定が実際にどれだけの差を生むかを数値で示す。

YouTube配信を最適化する2026年版の書き出し設定 ——高品質なエンコーダーを発動させる具体的な手順と設定値を、理由とともに提供する。

理論と実践の両方を、現場でそのまま使える形で提供する。

ここから先は有料部分です。 購入後、すべての実践ノウハウが公開されます。

コメント