ラウドネス管理・位相制御・ノイズ低減の統合実践ガイド

対象読者:大学の映画・映像学科や放送技術専門学校の「技術補習」を前提に、単なる再説明ではなく「現場で使える再構築」と「抜けている実務スキルの補完」が軸になります。映像制作・放送・IP配信・ライブイベントに携わるプロフェッショナル。 音はわかっているつもりだが、納品クレームやモノラル変換の失敗が後を絶たないあなたへ。

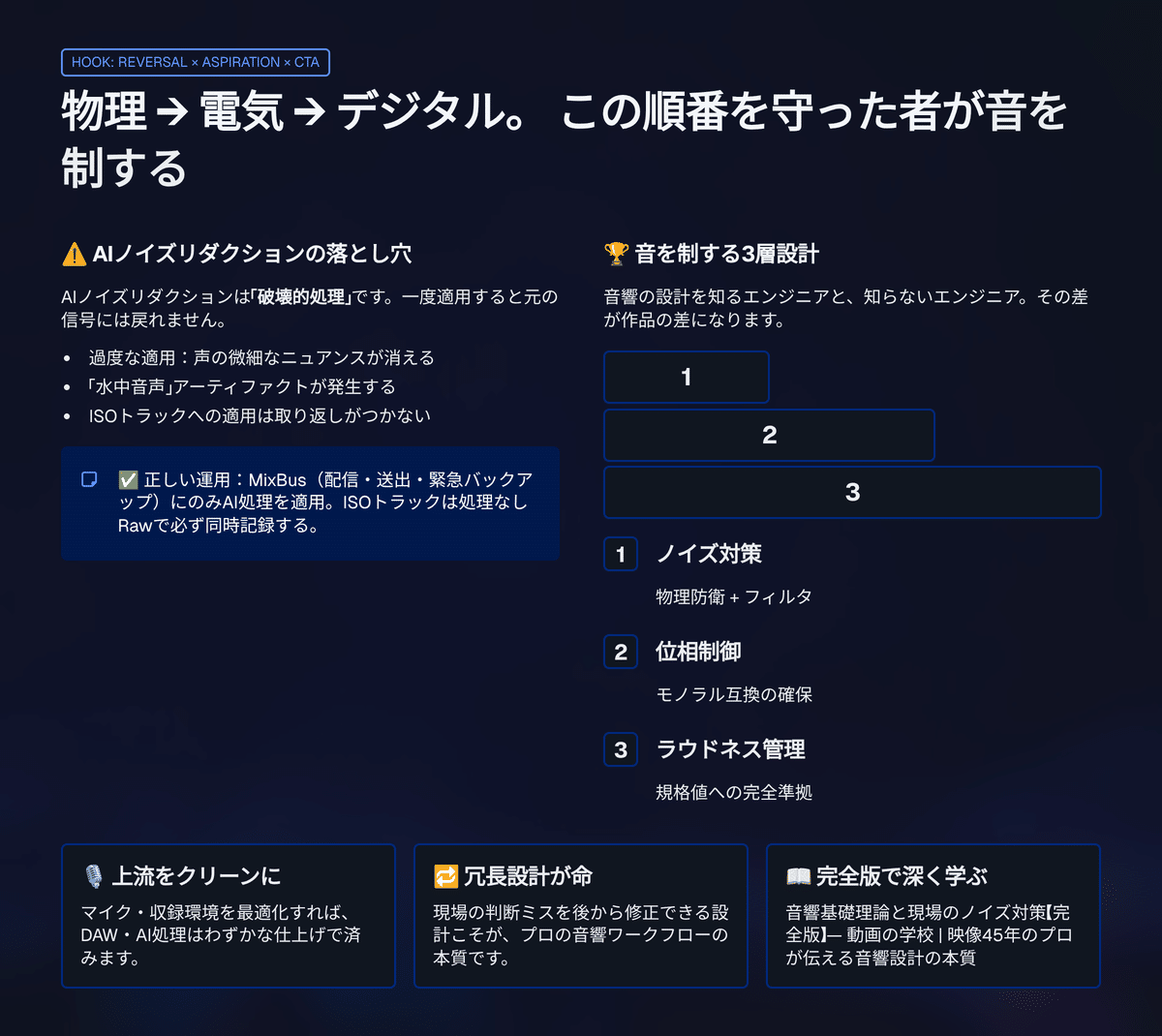

なぜ「音が通らない」現場が生まれるのか

現場で音の問題が起きたとき、最初に疑われるのはたいていマイクかケーブルだ。だが、実際にトラブルの根を掘り下げると、犯人はほぼ決まって「数値管理の甘さ」か「物理対策の後回し」のどちらかである。

たとえばこんな経験はないだろうか。

収録本番で音量バランスは完璧に仕上げた。編集も丁寧にやった。ところが納品後に「スマートフォンで聴くと声が消えている」と連絡が来る。あるいは、放送局の自動ラウドネス補正がかかって音が潰れてしまい、オンエア結果が現場の意図とまるで別物になる。ロケ現場では風の音が入り込んで音声が破綻し、ポスト作業で数時間を溶かす羽目になる。

これらはすべて、個別の機材問題ではなく「音響設計の上流」にある。

音声トラブルの発生源は「上流の3層」に集中する

音声クオリティの問題は、発生源を整理すると3層に分けて考えることができる。

第1層:レベルと知覚の乖離(ラウドネス管理) デジタルメーターの数字は見ているが、それが「人間の耳が感じる音量」とズレているケースだ。日本の地上波放送規格(ARIB TR-B32)では統合ラウドネス値を-24.0 LKFS ±1.0 LU以内に収める義務がある(出典:ARIB TR-B32, 2011年策定)。これを知らずに波形のピークだけを見て納品すると、放送局側の自動補正で音が歪む。

第2層:ステレオ信号内の位相問題 左右チャンネルの時間的なズレや逆位相成分は、ステレオ再生では気づきにくい。しかしモノラル再生環境(一部のスマートスピーカー、テレビの内蔵スピーカーなど)では、左右信号が合成されたとき特定周波数が打ち消し合い、最悪のケースでは無音になる。

第3層:環境ノイズの混入(物理・電気・空間) 風、ハム、部屋の反響。これらはデジタル処理で取り除けると思われがちだが、AIノイズリダクションを含む最新技術でも、取り除けるのはあくまで「後から加算されたノイズ」であり、信号とノイズが完全に混じり合った状態では元の音質は取り戻せない。

解決策は「順番」にある

この記事が伝えるのは、音響技術の「順番」だ。

物理対策を最初に。電気対策を次に。デジタル処理は最後の仕上げとして。この優先順位を守ったエンジニアリングだけが、再生環境を選ばないクリーンな音声を生み出す。

有料部分では、以下の内容をすべて数値と手順で詳述する。

- ラウドネス規格(ARIB・EBU・YouTube等)の実際の数値と、現場でどう合わせるか

- 位相が崩れているかどうかをメーターで判定する基準値

- MS録音方式がモノラル互換性において数学的に優位な理由

- 風速ごとに選ぶべきウィンドスクリーンの種類と、ハイパスフィルタとの組み合わせ方

- ハムノイズ・グランドループをDIボックスで物理的に切断する手順

- 吸音材の設置場所と、低音域の反響を抑えるためのエアギャップの寸法

- CEDAR sdnxとNoiseAssistのレイテンシ・対応サンプルレートの違いと使い分け

- AIノイズリダクション使用時のISOトラック分離記録のワークフロー

- ポストプロダクションへのメタデータ継承と、32bit float録音時の注意点

- 記憶定着に最適化した要約(ポイント・記憶術・メンタルモデル)

「音がわかっているエンジニア」と「音を設計できるエンジニア」の差は、この「順番の知識」にある。

コメント