最適化なき運用が引き起こす、見えないパフォーマンスロスの正体

IPネットワーク経由でNDI映像を橋渡しするNDI Bridge。

インストールして接続が通った瞬間、「よし、完成」と思ったことはないだろうか。

その感覚は正直、わかる。

画が出れば合格——それがライブ映像の現場感だ。

だが、ちょっと待ってほしい。

NDI Bridgeが「映像は出ている」状態と「最適なパフォーマンスで動いている」状態は、

まったく別物だ。

現場で起きている「気づかれない劣化」

こんなトラブルに心当たりはないか。

PCを再起動したら、NDI Bridgeの接続が切れたまま誰も気づかなかった。

本番2時間前、オペレーターが会場入りしてから発覚した——。

または、10ビットの高品質映像を送っているはずなのに、

受信側でのデコード負荷がCPUに集中して、スイッチャーのUIがカクつく。

これらは「設定が間違っている」のではなく、

「最適化されていないまま動いている」状態から生まれるトラブルだ。

NDI 6.3リリースノートによれば、過去のバージョンでは

システム起動時にNDI Bridgeが自動起動しない不具合が報告されており、

NDI 6.3.1およびNDI 6.2.1でようやく修正が完了している。

つまり、バージョンアップをしていない環境では、

今この瞬間も「起動忘れ」リスクを抱えたまま本番を迎えている可能性がある。

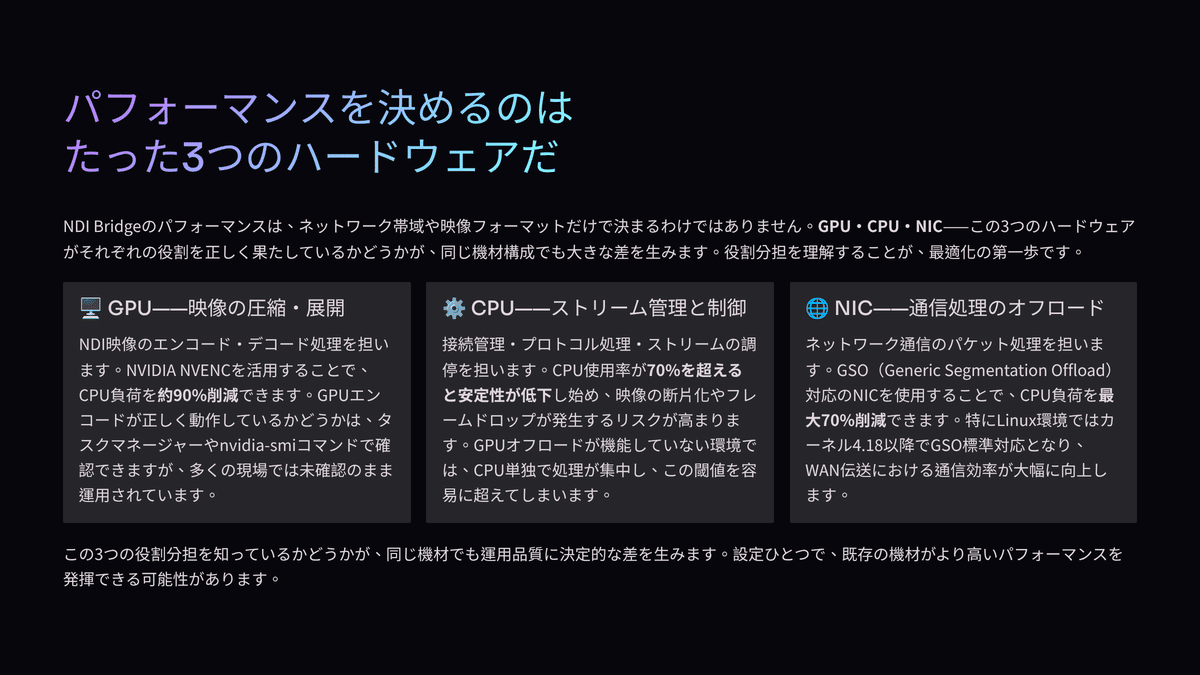

PCの「スペックを選ぶ理由」は、思っているのと違う

NDI Bridgeを動かすなら、「なんとなく高スペックなPC」を用意しておけば大丈夫——

そう考えているなら、少し立ち止まって考え直してほしい。

NDI Bridgeのパフォーマンスを左右する要素は、

CPU・GPU・NIC(ネットワークカード)の3つに分解できる。

そして、それぞれが担う役割はまったく異なる。

CPUにしかできないことがある。

GPUにしかできないことがある。

そして、NICが担う仕事を正しく理解していないと、

「スペックは高いのになぜか重い」という現象が起きる。

この構造を理解することで、

同じ予算・同じ機材でも、パフォーマンスを引き出せる人とそうでない人が生まれる。

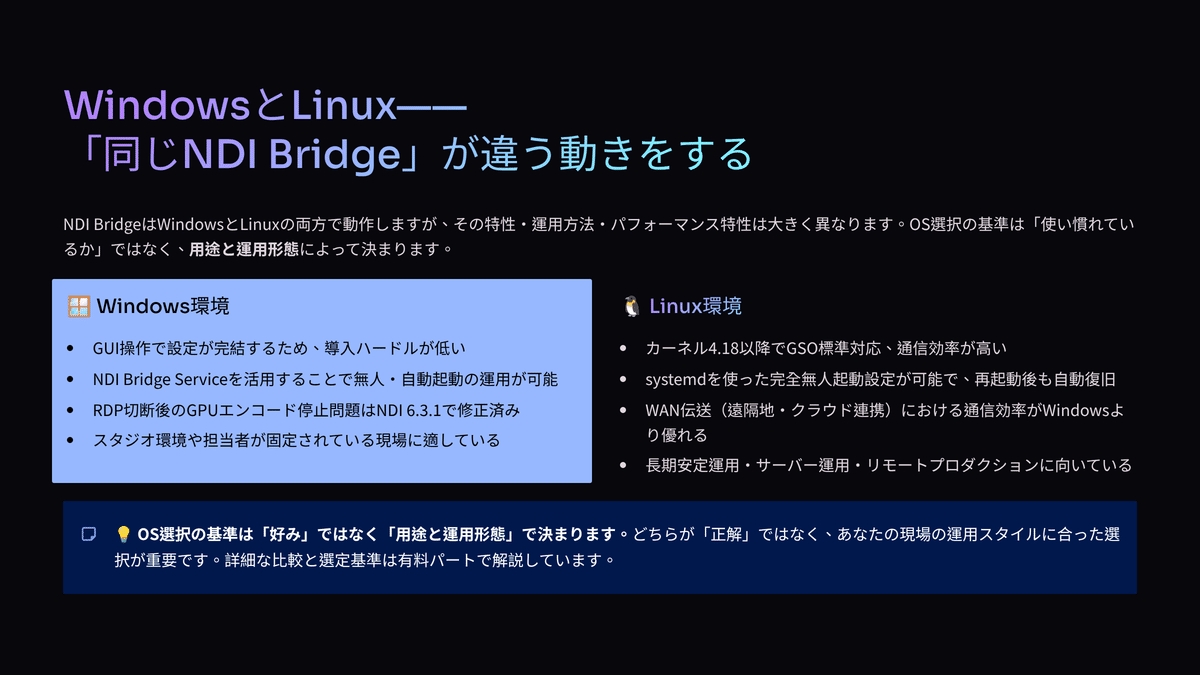

OSによって、同じハードでも出力が変わる

「WindowsとLinux、どちらでもNDI Bridgeは動く」——これは事実だ。

しかし、「同じように動く」は事実ではない。

特にネットワーク経由でRUDP(Reliable UDP:信頼性を確保したUDP通信)を

使ってNDI映像を転送する場合、Linuxカーネル4.18以降では

GSO(Generic Segmentation Offload)と呼ばれる機能が利用可能になる。

この機能が何をするのか、なぜWindowsとLinuxで挙動が違うのか——

その違いを知ることが、インフラ設計の精度を上げる第一歩になる。

この記事で手に入れられること

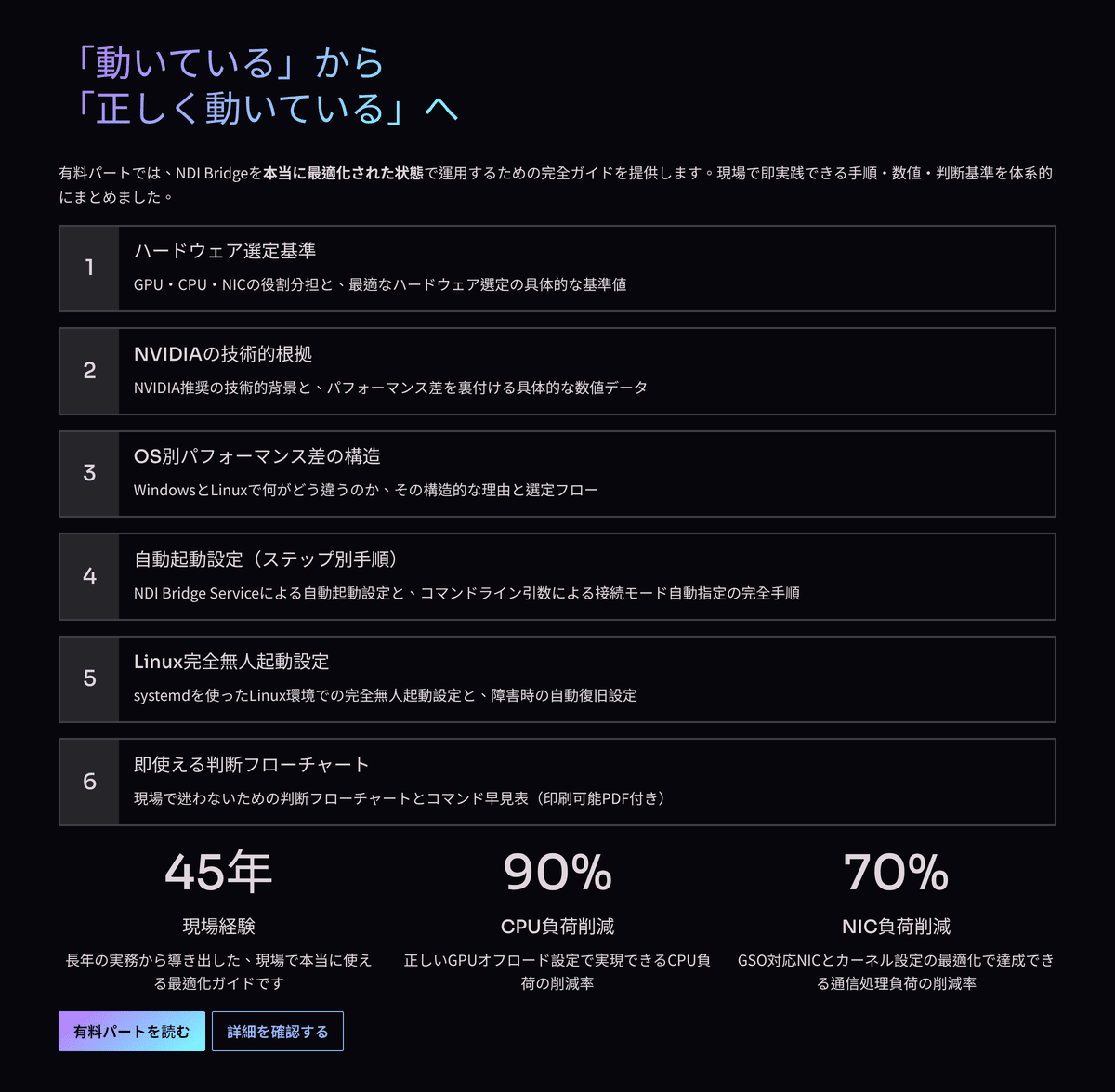

有料パートでは、以下を具体的な手順・数値とともに解説する。

- NDI BridgeにとってGPU・CPU・NICがそれぞれ何をしているのか

- NVIDIA製GPUが推奨される技術的な根拠

- AMD環境で過去に起きていた問題と、NDI 6.3.0で加えられた改善の内容

- WindowsとLinuxで異なるネットワーク処理能力の構造的な差

- NDI Bridge Serviceを使ったWindowsの自動起動設定(ステップ別手順)

- コマンドライン引数を使った接続モードの自動指定方法

- NDI Launcherのスタートアップ設定手順

現場で「設定が終わった状態」ではなく、

「最適化された状態」でNDI Bridgeを稼働させるための

実践的なガイドとして構成している。

45年間、放送・ライブイベント・IP映像伝送の現場を渡り歩いてきた経験から言えるのは、

「動いている」と「正しく動いている」の間には、深い溝がある、ということだ。

その溝を埋めることが、プロとしての仕事の質を決める。

以下、有料パートに続く

コメント