映像を「見せる」から「聴かせる」へ。音響設計で作品の価値を決める技術。

音が「なんとなく合ってる」では、もう通用しない

ベテランほど陥る「音の勘頼り」

映像のキャリアを20年、30年積んだプロが、MAの現場に入った途端に口にする言葉がある。

「なんとなくこのくらいの音量で、ちょっとBGMを下げて……」

撮影やスイッチング、IP伝送の設計では数値で語れるのに、音だけはなぜか感覚で進める。それでも今まで「なんとか通ってきた」から、問題だと気づかない。

しかし現実は変わっている。

放送局・OTTプラットフォーム・企業VP納品の現場では、音量の規格がすでに数値で定められており、基準を外れた素材は受け取り拒否か再納品扱いになる。「音が大きめ」「なんとなく聴こえる」では、第一線の発注者を満足させられない時代に突入している。

「耳で合わせた」ミックスが崩壊する瞬間

あなたは、こんな経験をしたことはないだろうか。

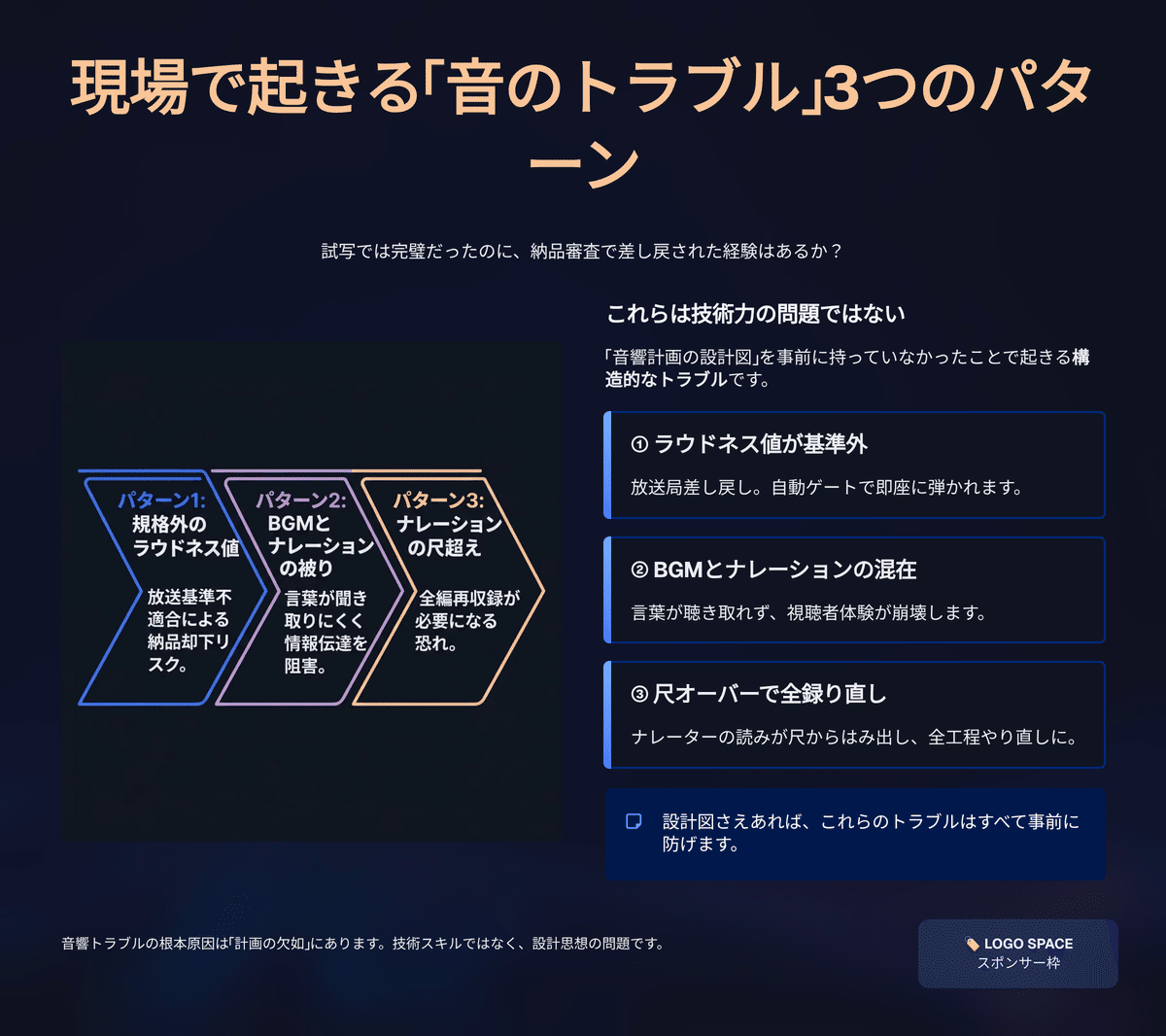

試写では完璧に聴こえたナレーションが、放送局への納品審査で「ラウドネス値が基準外」として差し戻されたことは?

丁寧に選んだBGMが、ナレーションと重なった途端に言葉が聴き取れなくなることは?

そして、「もう1秒だけ短く読んで」とナレーターに頼んだのに、全部録り直しになったことは?

これらは技術力の問題ではない。音響計画の設計図を事前に持っていなかったことで起きる、構造的なトラブルだ。

MA(Multi Audio)は「編集が終わったあとで音を整える作業」ではない。撮影の段階から設計が始まる、戦略的なプロセスである。

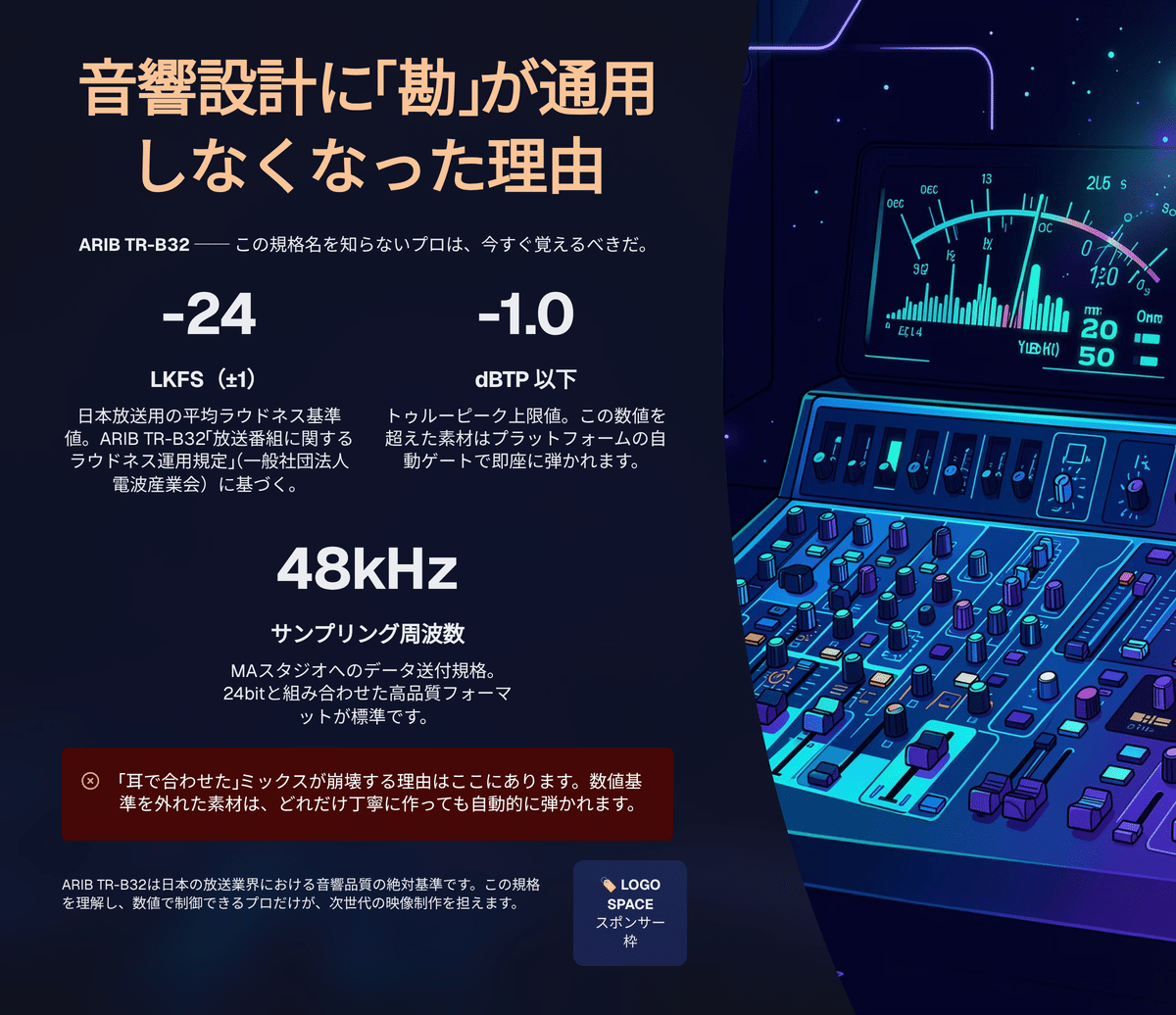

音響設計に「勘」が通用しなくなった3つの理由

第一に、納品規格の数値化が完成している。 日本の放送用素材には、ARIB TR-B32という業界標準規定が存在し、平均ラウドネス値は -24 LKFS(±1の許容範囲) と数値で定められている(出典:ARIB TR-B32「放送番組に関するラウドネス運用規定」)。この数値を知らずに制作した素材は、プラットフォームの自動ゲートで弾かれる。

第二に、ナレーション収録の精度が映像の「尺」に直結している。 タイムコード「10;01;54;25」という1フレーム単位の指示を出せないディレクターは、スタジオの時間を2倍以上消費する。

第三に、AIツールが音響制作の一部を担い始めている。 Perplexity AIなどのリサーチ支援ツールの導入により、音響素材のリサーチ時間が50%以上短縮されたという報告が制作現場から上がっている(出典:前掲資料「MAの高度な理論と実践」)。AIが効率を担う分、人間は「この音は本当に必要か」という判断に集中できる。

この記事で得られること

本記事の有料部分では 、MA音響計画を「撮影前の準備」から「最終ラウドネス調整」まで、一連のプロセスとして体系化する。

扱う内容は、スタジオへのデータ送付規格・ナレーター選定とオーディション評価の科学・タイムコードを使った1フレーム単位のディレクション・BGMと効果音の役割分担設計・ダッキングの数値パラメーター・ARIB TR-B32準拠のラウドネス管理──これらすべてを、実務で明日から使える手順として記述する。

「なんとなく合ってる」から「数値で証明できる」へ。音響設計の地図をここで手に入れてほしい。

以下は有料エリアです。

コメント