背景と演者がズレ続ける「本当の原因」と、現場で即使える解決手順

本番中に背景が「生き物のように動いた」

撮影開始から3分が経ったとき、モニターに映る仮想ビルが揺れ始めた。

カメラは固定している。タレントも止まっている。それなのにLEDウォールに映し出された建物の柱が、まるで水中に沈んでいるかのようにゆらゆらとずれていく。技術スタッフ全員がモニターを凝視した。誰も声を出さなかった。

トラッキングシステムのステータスランプは全てグリーン。ケーブルに断線なし。レンダリングPCも正常稼働中。それでも映像は嘘をついていた。

原因に気づいたのは、その日の撮影が終わってからだった。

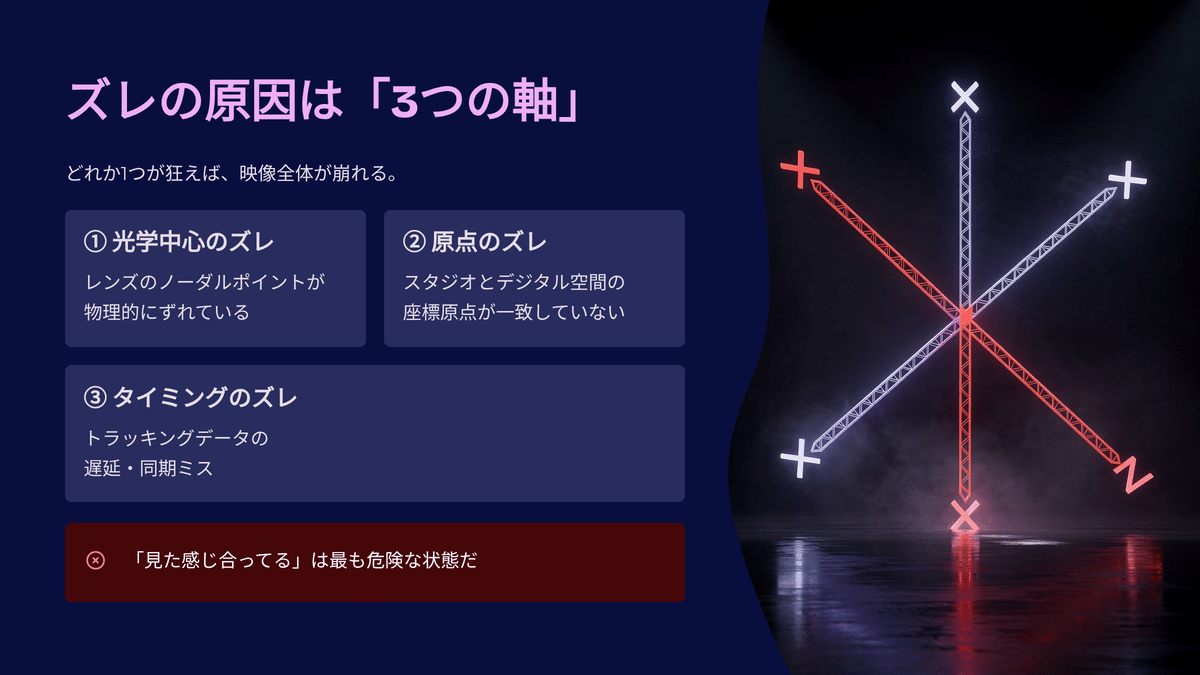

なぜズレは起きるのか——3つの「軸」のどれかが狂っている

バーチャルプロダクションで背景と演者の位置関係が崩れる原因は、構造的に3つの軸に分けられる。

第一の軸:カメラレンズの「回転中心」がずれている レンズには光が一点に集まる「光学的な中心点」がある。カメラを動かすとき、この点を中心に動かさないと、仮想空間のパースペクティブ(遠近感)が物理法則から外れる。

第二の軸:スタジオの「床の0点」と、エンジン内の「仮想の0点」が一致していない 物理空間の座標系とデジタル空間の座標系を正確に重ね合わせる作業が不完全だと、どれだけカメラを精密にトラッキングしても背景はずれ続ける。

第三の軸:トラッキングデータの「タイミングのゆれ」 カメラ位置情報がレンダリングエンジンに届くタイミングがコマ単位でブレると、演者と背景の動きが食い違う。

この3軸は互いに独立している。どれか1つでも狂えば映像は破綻する。そして現場でよくある誤りは、「見た目が合っているから大丈夫」という判断で撮影を続けることだ。

XRステージ(LEDパネルに囲まれた撮影環境)の場合、物理的な計測誤差が1cmあるだけでLEDパネルのつなぎ目の「角」がCG空間内で致命的なノイズとして現れる(Pixotope社・バーチャルプロダクション技術資料)。1cmは、親指の爪の幅だ。

「合ってるように見える」が最も危険な状態だ

バーチャルプロダクションのエキスパートたちが口をそろえて指摘するのが「It looks fine(見た感じ大丈夫そうだ)という慢心」だ。

これがなぜ危険かというと、ずれは「小さい動き」では気づきにくく、「大きく動いたとき」に一気に露呈するからだ。

こんな想像をしてほしい。コマを回すとき、軸がほんのわずかに中心からずれていたとする。最初はほとんどブレを感じない。しかし回転が速くなればなるほど、軸のズレは先端の振れとして増幅されていく。カメラの光学中心のずれも、まさに同じ構造だ。カメラを大きくパンしたとき、ズームを引いたとき——それまで隠れていたズレが、突然「映像の嘘」として画面に現れる。

現場でこれが発覚するのは、たいていリハーサルではなく本番だ。

正確な位置合わせは、手順を踏めば確実に実現できる

この問題は、才能や経験値だけで乗り越えるものではない。正しい手順と正しい工具があれば、再現性を持って解決できる技術的な課題だ。

具体的には、

- レンズの光学中心を物理的に特定して、トラッキングシステムに正確なオフセット値を入力する方法

- スタジオの物理空間とエンジン内のデジタル空間を、ミリメートル単位で一致させる手順

- 本番前に「ズレが隠れていないか」を確認するチェックリスト

- トラッキングデータ専用ネットワークの分離設計

- AI・自動キャリブレーションツールの現在の水準と限界

——これらを、実際の現場ワークフローに沿った順序でこの先に書いている。

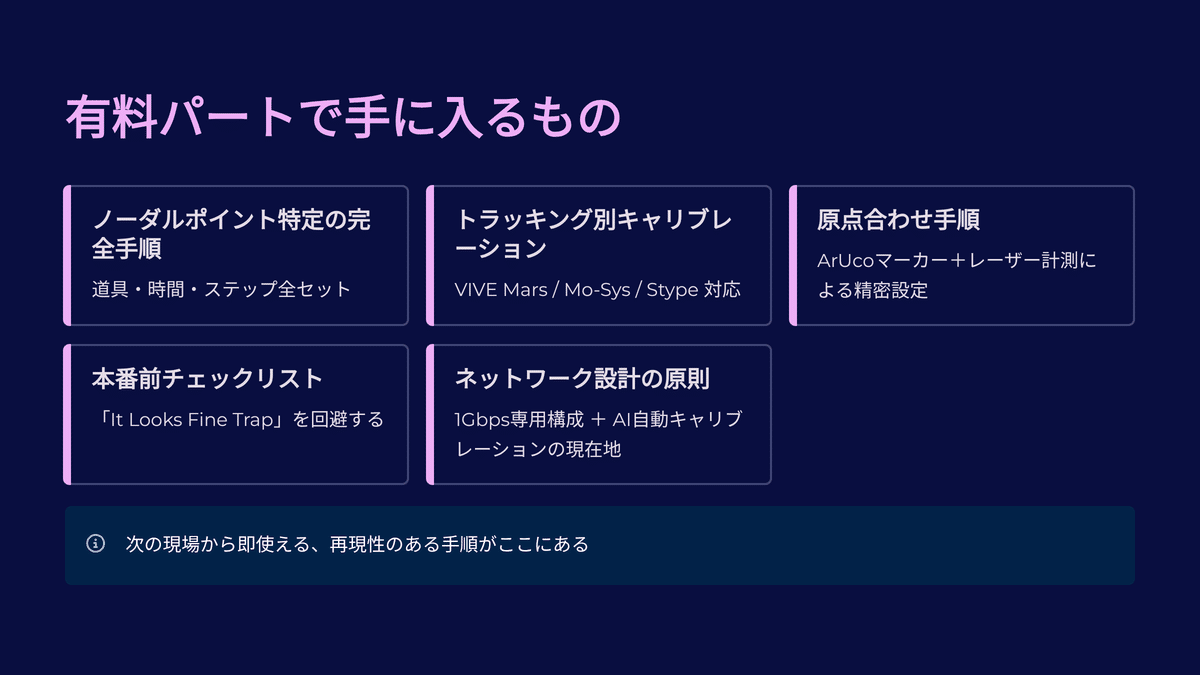

この先の有料部で手に入るもの

- 光学中心(ノーダルポイント)の特定手順:道具と時間と手順の全セット

- トラッキングシステム別の設定アプローチ:VIVE Mars・Mo-Sys StarTracker・Stype RedSpyそれぞれの考え方と工夫

- 物理空間とデジタル空間の原点合わせ:ArUcoマーカーとレーザー計測の使い分け

- 本番前チェックリスト:「It looks fine trap」を確実に回避するための運用管理

- 専用ネットワーク設計:トラッキングデータのパケットロスをゼロに抑える構成

- AI自動キャリブレーションの最前線:Vizrt・Cooke /i Technologyの現在地

私が45年の現場で学んだことは、「見た感じ合っている」を信用しないことだ。

この設定を知らないまま本番を迎えると、撮影後に発覚したズレの修正作業はフル撮り直しに直結する。1日のスタジオ稼働を無駄にしないための手順が、このあとにある。

コメント